Trong thời đại số hóa hiện nay, dữ liệu được tạo ra với tốc độ chóng mặt, từ các nghiên cứu khoa học phức tạp đến hoạt động kinh doanh hàng ngày. Sự bùng nổ dữ liệu này đặt ra một thách thức lớn: làm thế nào để xử lý, phân tích và khai thác thông tin từ những tập dữ liệu khổng lồ một cách hiệu quả? Các hệ thống máy tính truyền thống thường không đủ sức mạnh để giải quyết những bài toán tính toán phức tạp này. Đây chính là lúc công nghệ tính toán hiệu năng cao (HPC) trở thành giải pháp vượt trội. HPC cung cấp sức mạnh cần thiết để xử lý các tác vụ nặng, giúp các nhà khoa học và kỹ sư đẩy nhanh quá trình đổi mới sáng tạo. Bài viết này sẽ đi sâu vào định nghĩa HPC, tầm quan trọng, các ứng dụng thực tiễn, cơ chế hoạt động, và tương lai của công nghệ đột phá này.

Giới thiệu về HPC

Bạn đã bao giờ tự hỏi làm thế nào các nhà khoa học có thể dự báo bão, thiết kế ra một loại thuốc mới, hay mô phỏng một vụ nổ siêu tân tinh chưa? Câu trả lời nằm ở một công nghệ mang tên High-Performance Computing (HPC), hay Tính toán hiệu năng cao. Trong bối cảnh thế giới vận hành dựa trên dữ liệu, từ phân tích gen đến giao dịch tài chính, HPC đã trở thành một công cụ không thể thiếu, là động lực thúc đẩy những bước tiến vượt bậc trong khoa học và công nghiệp.

Vấn đề lớn mà nhiều tổ chức gặp phải là sự quá tải của các hệ thống máy tính thông thường. Khi phải đối mặt với các mô hình tính toán yêu cầu hàng nghìn tỷ phép tính mỗi giây hoặc phân tích các bộ dữ liệu lên đến petabyte, chúng nhanh chóng trở nên chậm chạp và kém hiệu quả. Điều này làm cản trở đáng kể tốc độ nghiên cứu và phát triển.

Để giải quyết bài toán này, HPC ra đời như một giải pháp toàn diện. Nó không chỉ là một chiếc máy tính mạnh hơn, mà là một hệ thống bao gồm nhiều máy chủ được kết nối với nhau, hoạt động đồng bộ để giải quyết một vấn đề chung. Hãy tưởng tượng thay vì một người làm việc, bạn có cả một đội quân cùng chung sức. Sức mạnh tổng hợp này giúp xử lý các nhiệm vụ phức tạp trong vài giờ, thay vì mất hàng tuần hay hàng tháng.

Trong bài viết này, chúng ta sẽ cùng nhau khám phá mọi khía cạnh của HPC. Bắt đầu từ định nghĩa “HPC là gì“, tìm hiểu các ứng dụng quan trọng của nó trong thực tế, cách thức hoạt động của một hệ thống HPC, so sánh nó với các phương pháp truyền thống và cuối cùng là nhìn về tương lai đầy hứa hẹn của công nghệ này.

Định nghĩa HPC và tầm quan trọng trong công nghệ

Để thực sự hiểu sức mạnh của HPC, trước tiên chúng ta cần làm rõ khái niệm cốt lõi và tại sao nó lại quan trọng đến vậy trong thế giới công nghệ ngày nay. HPC không chỉ là một thuật ngữ thời thượng, mà là một lĩnh vực nền tảng cho nhiều đổi mới.

HPC là gì?

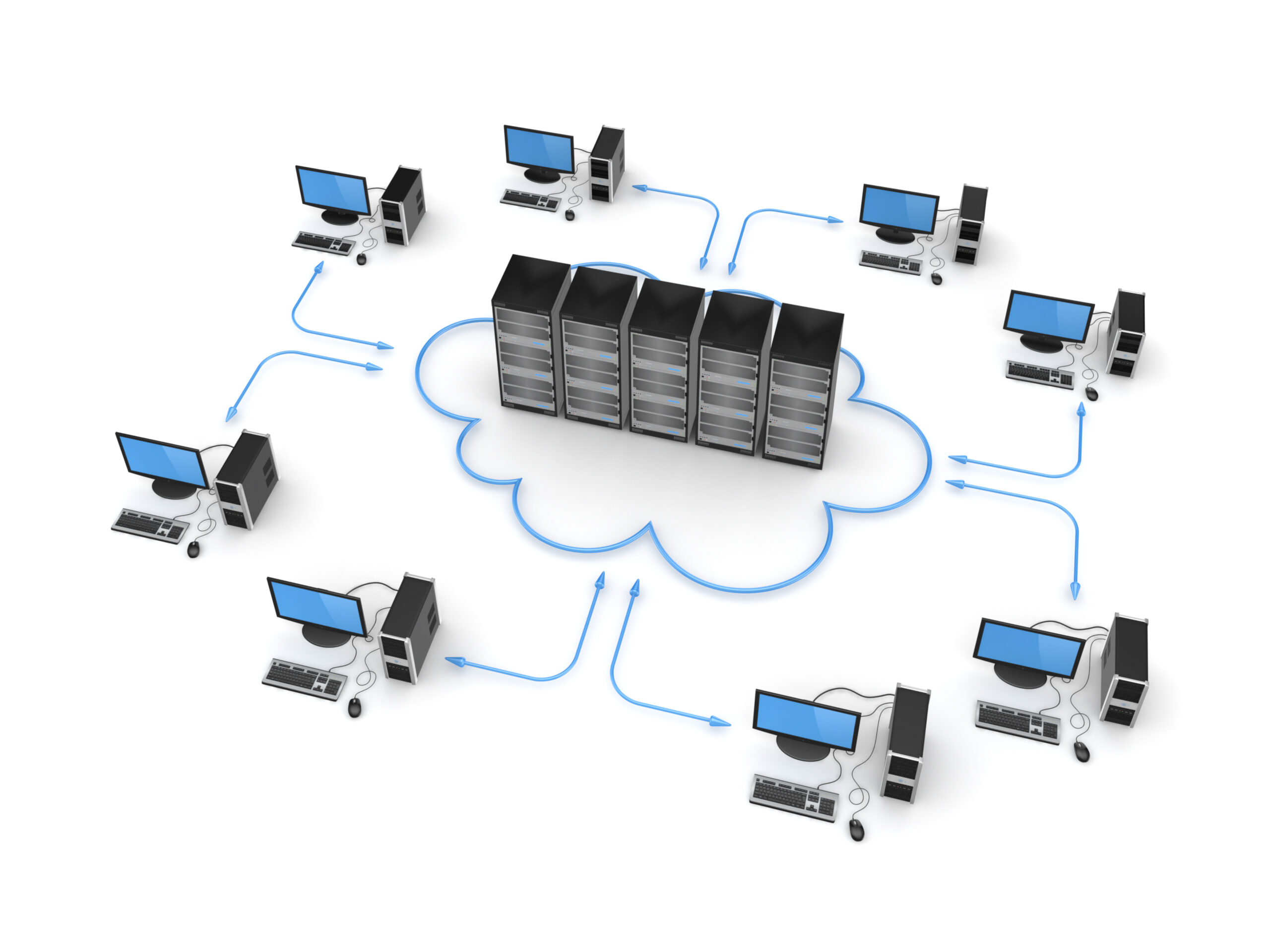

HPC, viết tắt của High-Performance Computing (Tính toán hiệu năng cao), là việc sử dụng các hệ thống máy tính cực mạnh và kỹ thuật xử lý song song để giải quyết các bài toán tính toán phức tạp. Thay vì dùng một máy tính duy nhất, hệ thống HPC kết hợp sức mạnh của hàng trăm hoặc hàng nghìn bộ xử lý hoạt động cùng lúc. Các bộ xử lý này được gọi là các “nút” (node), được kết nối với nhau bằng một mạng tốc độ cao.

Điểm khác biệt lớn nhất giữa HPC và máy tính thông thường nằm ở khả năng xử lý song song. Máy tính cá nhân của bạn thường thực hiện các tác vụ một cách tuần tự, tức là làm xong việc này mới đến việc khác. Ngược lại, HPC chia một bài toán lớn thành nhiều phần nhỏ và giao cho các nút xử lý đồng thời. Sau khi hoàn thành, kết quả từ các nút sẽ được tổng hợp lại. Quá trình này giúp giảm đáng kể thời gian tính toán và cho phép xử lý những vấn đề vượt xa khả năng của một máy tính đơn lẻ.

Tầm quan trọng của HPC trong kỷ nguyên công nghệ hiện đại

Trong kỷ nguyên số, HPC đóng vai trò then chốt, là xương sống cho nhiều đột phá khoa học và kỹ thuật. Tầm quan trọng của nó thể hiện rõ ở hai khía cạnh chính. Thứ nhất, HPC là công cụ không thể thiếu trong nghiên cứu khoa học. Nó cho phép các nhà khoa học mô phỏng các hiện tượng phức tạp như biến đổi khí hậu, tương tác phân tử để phát triển thuốc mới, hay hoạt động của vũ trụ. Những mô phỏng này giúp họ kiểm chứng giả thuyết mà không cần thực hiện các thí nghiệm tốn kém và nguy hiểm trong đời thực.

Thứ hai, HPC ảnh hưởng trực tiếp đến năng suất và sự đổi mới trong công nghiệp. Các công ty sản xuất ô tô dùng HPC để mô phỏng các bài kiểm tra va chạm, giúp tạo ra những chiếc xe an toàn hơn mà không cần phá hủy mẫu thử. Trong ngành tài chính, HPC được dùng để phân tích rủi ro thị trường và thực hiện giao dịch tần suất cao. Bằng cách rút ngắn thời gian từ ý tưởng đến sản phẩm, HPC giúp doanh nghiệp chiếm lợi thế cạnh tranh và thúc đẩy sự sáng tạo không ngừng.

Các ứng dụng chính của HPC trong khoa học và kỹ thuật

Sức mạnh của HPC không chỉ nằm ở lý thuyết. Nó đã và đang được áp dụng rộng rãi trong nhiều lĩnh vực, mang lại những kết quả đột phá và thay đổi cách chúng ta tiếp cận các vấn đề phức tạp trong khoa học và công nghiệp.

Ứng dụng trong nghiên cứu khoa học

HPC là công cụ đắc lực cho các nhà khoa học, cho phép họ khám phá những giới hạn mới của tri thức. Một trong những ứng dụng nổi bật nhất là mô phỏng khí hậu. Các hệ thống HPC có thể xử lý lượng dữ liệu khổng lồ từ vệ tinh, cảm biến và các nguồn khác để xây dựng các mô hình dự báo thời tiết chính xác hơn và nghiên cứu tác động lâu dài của biến đổi khí hậu.

Trong lĩnh vực sinh học phân tử và y học, HPC đóng vai trò trung tâm. Nó được sử dụng để giải mã bộ gen người, mô phỏng cách protein gấp khúc (một quá trình quan trọng liên quan đến nhiều bệnh tật), và sàng lọc hàng triệu hợp chất hóa học để tìm ra các loại thuốc tiềm năng. Nhờ HPC, quá trình phát triển vắc-xin và các phương pháp điều trị mới được rút ngắn đáng kể. Tham khảo thêm Machine learning là gì và Deep learning là gì để biết cách HPC hỗ trợ trí tuệ nhân tạo trong lĩnh vực y học.

Ngoài ra, vật lý hạt nhân cũng là một lĩnh vực hưởng lợi lớn từ HPC. Các nhà vật lý sử dụng các siêu máy tính để mô phỏng các vụ va chạm hạt trong các máy gia tốc lớn như LHC, giúp họ hiểu rõ hơn về nguồn gốc của vũ trụ và các định luật cơ bản của tự nhiên. Điều này có liên quan đến bài viết Siêu máy tính là gì.

Ứng dụng trong kỹ thuật và công nghiệp

Trong thế giới kinh doanh, HPC giúp các doanh nghiệp đổi mới nhanh hơn và hiệu quả hơn. Ngành công nghiệp sản xuất sử dụng HPC để thiết kế và thử nghiệm sản phẩm ảo. Ví dụ, các hãng hàng không vũ trụ và ô tô dùng HPC để thực hiện các phân tích khí động học, tối ưu hóa thiết kế máy bay và xe hơi để tiết kiệm nhiên liệu và tăng hiệu suất. Các bài kiểm tra va chạm ảo cũng giúp giảm chi phí và thời gian phát triển sản phẩm.

Ngành năng lượng, đặc biệt là khai thác dầu khí, phụ thuộc rất nhiều vào HPC. Các công ty sử dụng nó để phân tích dữ liệu địa chấn phức tạp, từ đó xác định vị trí các trữ lượng dầu mỏ và khí đốt tiềm năng dưới lòng đất. Quá trình này đòi hỏi khả năng xử lý hình ảnh 3D và 4D khổng lồ, một nhiệm vụ chỉ HPC mới có thể đảm đương.

Ngành tài chính cũng không ngoại lệ. Các ngân hàng và quỹ đầu tư sử dụng HPC để xây dựng các mô hình định giá tài sản phức tạp, quản lý rủi ro danh mục đầu tư và phát triển các thuật toán giao dịch tần suất cao (HFT) có khả năng thực hiện hàng triệu lệnh mua bán trong vài giây.

Cách thức hoạt động và cơ chế tính toán hiệu năng cao

Để hiểu tại sao HPC lại mạnh mẽ đến vậy, chúng ta cần xem xét kiến trúc bên trong và cách nó điều phối hàng nghìn bộ xử lý để hoạt động như một thể thống nhất. Cơ chế này là sự kết hợp tinh vi giữa phần cứng chuyên dụng và phần mềm thông minh.

Kiến trúc và mô hình tính toán HPC

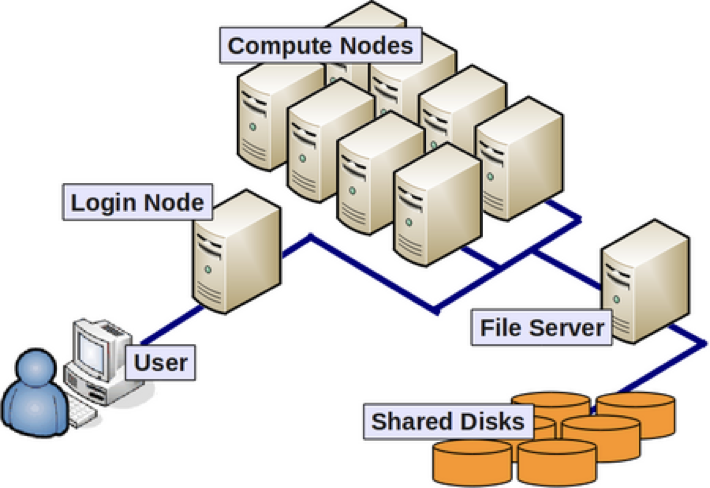

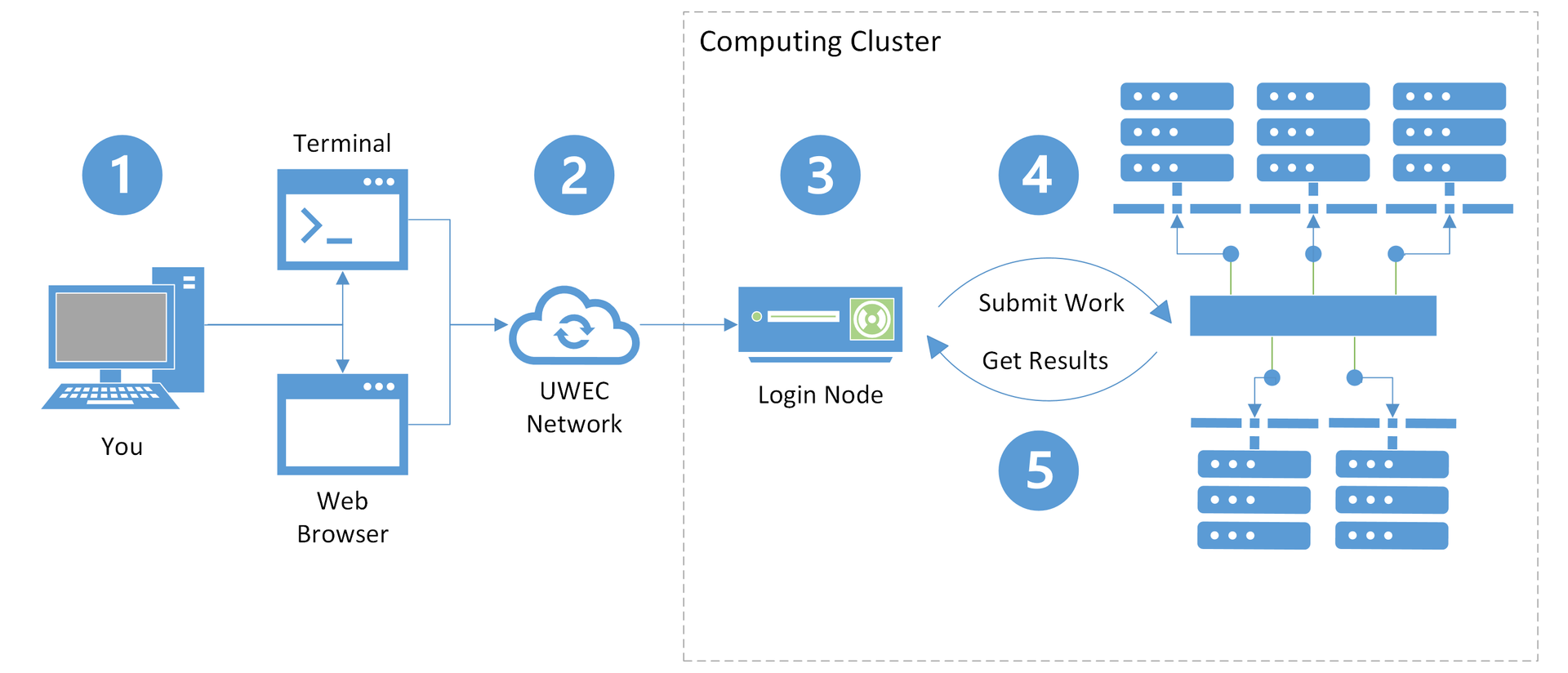

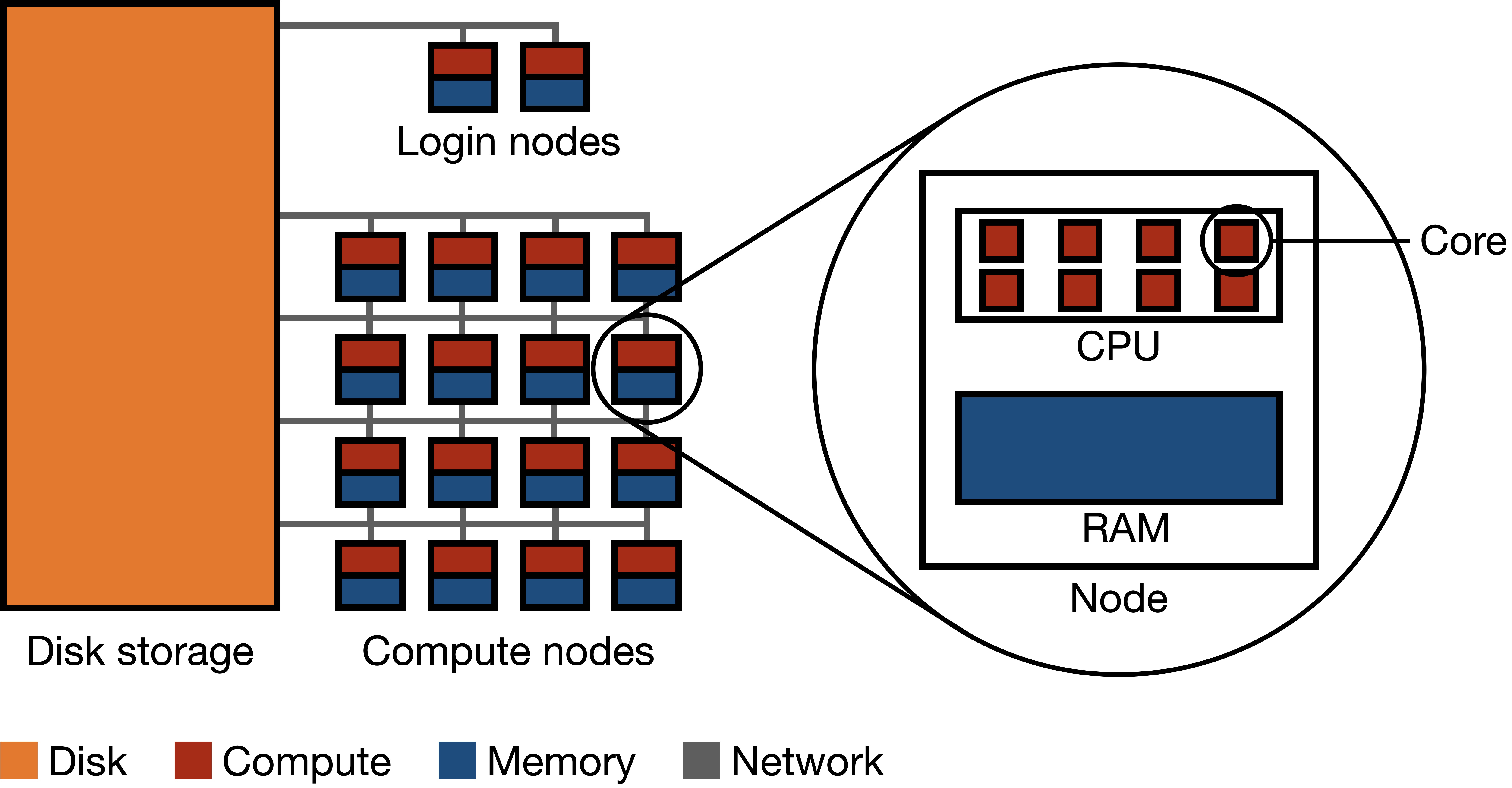

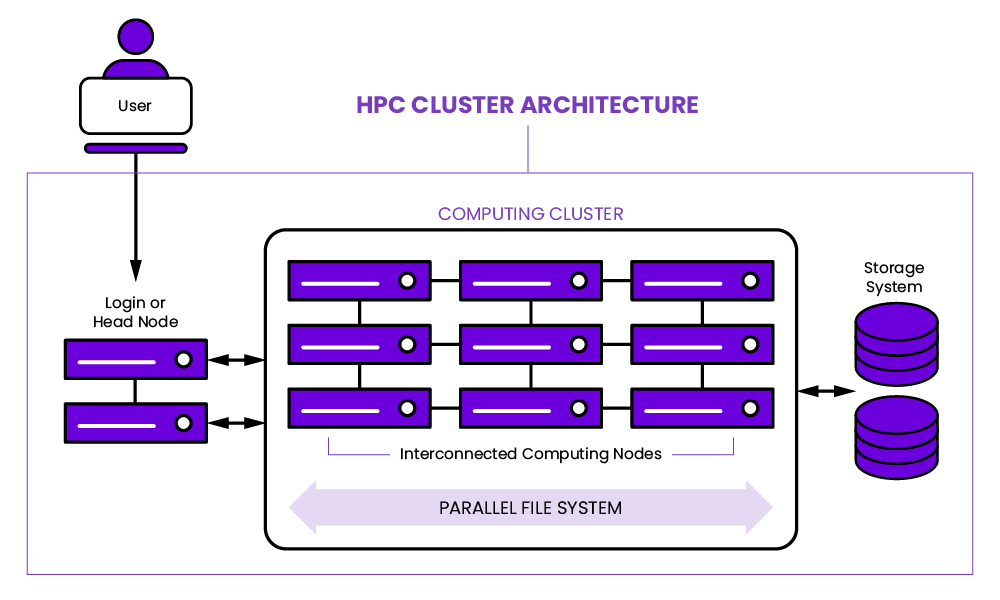

Một hệ thống HPC không phải là một máy tính đơn lẻ, mà là một cụm (cluster) gồm nhiều máy tính riêng lẻ được gọi là “nút” (node). Mỗi nút là một máy chủ hiệu năng cao, chứa nhiều bộ xử lý đa lõi (CPU), bộ nhớ RAM lớn và đôi khi cả bộ xử lý đồ họa (GPU là gì) để tăng tốc các tác vụ song song. Các nút này được kết nối với nhau thông qua một mạng liên kết tốc độ cực cao, chẳng hạn như InfiniBand hoặc Ethernet chuyên dụng. Mạng này có độ trễ rất thấp, cho phép các nút giao tiếp và trao đổi dữ liệu gần như tức thời, điều kiện tiên quyết cho việc xử lý song song hiệu quả.

Kiến trúc này được xây dựng xung quanh mô hình tính toán song song. Thay vì xử lý tác vụ một cách tuần tự, một bài toán lớn được chia thành nhiều phần nhỏ hơn. Mỗi phần được gửi đến một nút khác nhau trong cụm để xử lý đồng thời. Đây chính là nguyên tắc “chia để trị” được áp dụng ở quy mô lớn.

Quá trình xử lý và tối ưu hiệu năng

Quá trình hoạt động của một hệ thống HPC bắt đầu khi người dùng gửi một yêu cầu tính toán, hay còn gọi là một “job”. Một phần mềm đặc biệt gọi là bộ lập lịch (scheduler) sẽ tiếp nhận yêu cầu này. Bộ lập lịch có nhiệm vụ quản lý tài nguyên của toàn bộ cụm máy tính.

Đầu tiên, bộ lập lịch sẽ phân tích yêu cầu để xác định cần bao nhiêu nút, bao nhiêu bộ xử lý và bộ nhớ. Sau đó, nó sẽ tìm kiếm các tài nguyên trống trong cụm và phân bổ chúng cho job đó. Quá trình này gọi là phân bổ tài nguyên.

Tiếp theo là giai đoạn song song hóa tác vụ. Ứng dụng hoặc thuật toán phải được thiết kế để có thể chạy song song. Các phần nhỏ của bài toán được gửi đến các nút đã được phân bổ. Các nút này sẽ làm việc độc lập nhưng vẫn liên tục trao đổi dữ liệu với nhau qua mạng tốc độ cao khi cần thiết. Cuối cùng, khi tất cả các nút đã hoàn thành nhiệm vụ của mình, kết quả của chúng được tổng hợp lại để đưa ra câu trả lời cuối cùng cho bài toán ban đầu. Toàn bộ quá trình này được tối ưu hóa để đảm bảo hiệu năng cao nhất và thời gian chờ đợi thấp nhất.

Lợi ích khi sử dụng HPC trong xử lý dữ liệu lớn

Việc áp dụng HPC không chỉ là một nâng cấp về công nghệ, mà còn mang lại những lợi ích chiến lược rõ rệt, đặc biệt là trong bối cảnh dữ liệu lớn (Big Data là gì) ngày càng trở nên quan trọng. HPC giúp biến dữ liệu từ một thách thức thành một lợi thế cạnh tranh.

Tăng tốc xử lý và phân tích dữ liệu

Lợi ích rõ ràng và trực tiếp nhất của HPC là tốc độ. Đối với các bài toán yêu cầu hàng nghìn tỷ phép tính, một máy tính thông thường có thể mất hàng tuần, hàng tháng, thậm chí hàng năm để hoàn thành. Với HPC, thời gian này có thể được rút ngắn đáng kể. Ví dụ, một mô phỏng phức tạp trong ngành dược phẩm có thể được thực hiện trong vài giờ thay vì vài ngày.

Việc tăng tốc này không chỉ tiết kiệm thời gian mà còn cho phép các nhà nghiên cứu và kỹ sư thực hiện nhiều thử nghiệm hơn trong cùng một khoảng thời gian. Họ có thể kiểm tra nhiều giả thuyết hơn, chạy nhiều kịch bản mô phỏng hơn và tinh chỉnh các mô hình của mình nhanh hơn. Điều này đẩy nhanh vòng lặp đổi mới và cho phép đưa ra quyết định dựa trên dữ liệu một cách kịp thời, thay vì phải chờ đợi kết quả phân tích quá lâu.

Cải thiện độ chính xác và khả năng mở rộng

Bên cạnh tốc độ, HPC còn cho phép chúng ta giải quyết các vấn đề với độ phức tạp và chi tiết cao hơn. Với sức mạnh tính toán vượt trội, các nhà khoa học có thể xây dựng những mô hình mô phỏng chứa nhiều biến số hơn và có độ phân giải cao hơn. Ví dụ, trong dự báo thời tiết, một mô hình chi tiết hơn sẽ tính đến nhiều yếu tố khí quyển hơn, từ đó đưa ra dự báo chính xác hơn.

Khả năng mở rộng cũng là một ưu điểm lớn. Các hệ thống HPC được thiết kế theo dạng mô-đun. Khi nhu cầu tính toán tăng lên hoặc kích thước dữ liệu trở nên lớn hơn, người dùng có thể dễ dàng thêm các nút mới vào cụm máy tính để tăng cường sức mạnh. Điều này mang lại sự linh hoạt to lớn, cho phép các tổ chức bắt đầu với một hệ thống nhỏ và mở rộng dần theo quy mô dự án mà không cần phải thay thế toàn bộ cơ sở hạ tầng. Khả năng xử lý các bộ dữ liệu đa dạng, từ nhỏ đến cực lớn, làm cho HPC trở thành một giải pháp bền vững cho tương lai.

Các công nghệ và phần cứng hỗ trợ HPC

Để đạt được hiệu năng vượt trội, một hệ thống HPC không chỉ dựa vào số lượng lớn máy chủ mà còn cần đến sự kết hợp của các thành phần phần cứng chuyên dụng và phần mềm quản lý tinh vi. Đây là những yếu tố tạo nên sức mạnh của HPC.

Về phần cứng, trái tim của mỗi nút trong cụm HPC thường là các máy chủ được trang bị CPU cao cấp như Intel Xeon hoặc AMD EPYC, vốn được thiết kế để xử lý khối lượng công việc nặng và liên tục. Bên cạnh CPU, bộ xử lý đồ họa (GPU) ngày càng đóng vai trò quan trọng. Ban đầu được thiết kế cho game, GPU với hàng nghìn lõi xử lý nhỏ lại tỏ ra cực kỳ hiệu quả trong việc xử lý các tác vụ song song hàng loạt, như trong học máy và mô phỏng phân tử. Một số hệ thống còn sử dụng FPGA (Field-Programmable Gate Array), một loại chip có thể được lập trình lại để tối ưu cho các thuật toán cụ thể, mang lại hiệu suất tối đa cho các ứng dụng chuyên biệt.

Về phần mềm, hệ điều hành phổ biến nhất cho các hệ thống HPC là Linux do tính ổn định, linh hoạt và mã nguồn mở. Trên lớp hệ điều hành là các phần mềm quản lý tài nguyên và lập lịch (middleware) như Slurm, PBS Pro, hoặc LSF. Các công cụ này giống như bộ não của hệ thống, có nhiệm vụ phân chia công việc, quản lý hàng đợi, và đảm bảo rằng tài nguyên của cụm máy tính được sử dụng một cách hiệu quả nhất. Cuối cùng, các phần mềm đồ họa và trực quan hóa dữ liệu cũng rất quan trọng, giúp các nhà khoa học và kỹ sư diễn giải hàng terabyte dữ liệu đầu ra từ các mô phỏng một cách trực quan và dễ hiểu.

So sánh HPC với các phương pháp tính toán truyền thống

Để đánh giá đúng giá trị của HPC, việc đặt nó lên bàn cân với các phương pháp tính toán quen thuộc như máy tính cá nhân (PC) và máy chủ (server) thông thường là rất cần thiết. Sự khác biệt không chỉ nằm ở tốc độ, mà còn ở kiến trúc và mục đích sử dụng.

Sự khác biệt cốt lõi nhất nằm ở hiệu suất và khả năng xử lý song song. Một chiếc PC mạnh mẽ có thể có một CPU với 8 hoặc 16 lõi. Một máy chủ thông thường có thể có hai CPU với tổng số lõi nhiều hơn. Tuy nhiên, một hệ thống HPC có thể có hàng nghìn nút, mỗi nút lại có hàng chục lõi, tạo ra một hệ thống với hàng chục nghìn, thậm chí hàng triệu lõi hoạt động cùng lúc. Điều này cho phép HPC thực hiện các tác vụ song song ở quy mô mà PC và server không thể nào sánh được. Hiệu suất của HPC thường được đo bằng FLOPS (số phép tính dấu phẩy động mỗi giây), thường ở mức petaFLOPS (một triệu tỷ FLOPS) hoặc exaFLOPS (một tỷ tỷ FLOPS).

Về ưu điểm, HPC vượt trội trong việc giải quyết các bài toán quy mô lớn, yêu cầu tính toán chuyên sâu và xử lý dữ liệu khổng lồ. Tuy nhiên, nó cũng có những hạn chế. Chi phí đầu tư ban đầu cho phần cứng, phần mềm và cơ sở hạ tầng (như hệ thống làm mát và điện) là rất lớn. Việc vận hành và bảo trì một hệ thống HPC cũng đòi hỏi đội ngũ chuyên gia có kỹ năng cao. Ngược lại, máy tính cá nhân rất dễ tiếp cận và phù hợp cho các công việc hàng ngày. Server thông thường là lựa chọn tốt cho các ứng dụng doanh nghiệp như lưu trữ web, cơ sở dữ liệu, nhưng sẽ nhanh chóng đạt đến giới hạn khi đối mặt với các mô phỏng khoa học hay phân tích dữ liệu phức tạp.

Tương lai và xu hướng phát triển của HPC

Lĩnh vực tính toán hiệu năng cao đang không ngừng phát triển, được thúc đẩy bởi các công nghệ mới và nhu cầu ngày càng tăng về sức mạnh xử lý. Tương lai của HPC hứa hẹn sẽ thông minh hơn, dễ tiếp cận hơn và bền vững hơn.

Một trong những xu hướng rõ rệt nhất là sự hội tụ của HPC và Trí tuệ nhân tạo (AI), đặc biệt là học máy (Machine learning). Việc huấn luyện các mô hình AI phức tạp, như các mô hình ngôn ngữ lớn, đòi hỏi một nguồn tài nguyên tính toán khổng lồ. HPC cung cấp nền tảng lý tưởng cho các tác vụ này. Ngược lại, AI cũng có thể được sử dụng để tối ưu hóa hoạt động của chính các hệ thống HPC, ví dụ như dự đoán lỗi phần cứng hoặc tự động điều chỉnh việc phân bổ tài nguyên để đạt hiệu suất cao nhất.

Điện toán đám mây (Cloud Computing là gì) cũng đang thay đổi cách chúng ta tiếp cận HPC. Trước đây, chỉ các tổ chức lớn với ngân sách khổng lồ mới có thể xây dựng và vận hành một trung tâm HPC. Ngày nay, các nhà cung cấp dịch vụ đám mây hàng đầu như Amazon Web Services (AWS), Microsoft Azure và Google Cloud đều cung cấp dịch vụ HPC theo yêu cầu. Điều này cho phép các công ty nhỏ, startup và các nhóm nghiên cứu có thể thuê sức mạnh của siêu máy tính theo giờ, giúp dân chủ hóa khả năng tiếp cận công nghệ này.

Cuối cùng, khi các hệ thống HPC ngày càng lớn mạnh, vấn đề tiêu thụ năng lượng và tác động đến môi trường trở nên cấp thiết. Xu hướng HPC hướng tới năng lượng xanh và tính bền vững đang ngày càng được chú trọng. Các nhà sản xuất đang phát triển những bộ xử lý tiết kiệm điện hơn, và các trung tâm dữ liệu đang áp dụng những công nghệ làm mát tiên tiến, như làm mát bằng chất lỏng, để giảm lượng điện năng tiêu thụ. Tương lai của HPC không chỉ mạnh mẽ hơn mà còn phải “xanh” hơn.

Các vấn đề thường gặp và cách xử lý

Mặc dù HPC mang lại sức mạnh to lớn, việc triển khai và vận hành nó không phải lúc nào cũng suôn sẻ. Các tổ chức thường phải đối mặt với những thách thức về cả phần cứng và phần mềm. Tuy nhiên, với các giải pháp phù hợp, những vấn đề này hoàn toàn có thể được khắc phục.

Tối ưu hiệu suất phần cứng

Một trong những vấn đề phổ biến nhất là tình trạng “nghẽn cổ chai” (bottleneck), khi một thành phần yếu hơn trong hệ thống làm chậm toàn bộ quá trình. Ví dụ, các bộ xử lý có thể rất nhanh, nhưng nếu mạng kết nối giữa các nút chậm, hiệu suất tổng thể sẽ bị ảnh hưởng nghiêm trọng. Tương tự, nếu bộ nhớ hoặc hệ thống lưu trữ không đủ nhanh để cung cấp dữ liệu cho CPU/GPU, chúng sẽ phải ở trong trạng thái chờ, gây lãng phí tài nguyên.

Giải pháp cho vấn đề này là một cách tiếp cận cân bằng. Cần phải phân tích kỹ lưỡng loại công việc mà hệ thống sẽ thực hiện để lựa chọn các linh kiện phù hợp. Ví dụ, các tác vụ yêu cầu trao đổi dữ liệu liên tục cần đầu tư vào mạng liên kết tốc độ cao. Các tác vụ xử lý dữ liệu lớn cần hệ thống lưu trữ nhanh và bộ nhớ RAM dồi dào. Việc sử dụng các phần mềm quản lý tài nguyên thông minh cũng giúp giám sát hiệu suất, phát hiện các điểm nghẽn và tự động điều chỉnh để tối ưu hóa việc sử dụng phần cứng.

Khả năng tương thích phần mềm

Một thách thức lớn khác đến từ phần mềm. Không phải tất cả các ứng dụng đều được viết để tận dụng kiến trúc xử lý song song của HPC. Việc chạy một phần mềm được thiết kế cho máy tính đơn lõi trên một hệ thống HPC sẽ không mang lại bất kỳ lợi ích nào về tốc độ. Thậm chí, hiệu suất có thể kém hơn do độ trễ trong giao tiếp.

Để giải quyết vấn đề này, các nhà phát triển cần tối ưu hóa mã nguồn của họ. Điều này bao gồm việc sử dụng các thư viện và giao diện lập trình ứng dụng (API) song song như MPI (Message Passing Interface) và OpenMP. Quá trình này, được gọi là “song song hóa code”, đòi hỏi chuyên môn kỹ thuật cao. Đối với các tổ chức không có khả năng tự phát triển, giải pháp là lựa chọn các phần mềm thương mại hoặc mã nguồn mở đã được tối ưu hóa sẵn cho môi trường HPC. Việc lựa chọn một hệ sinh thái phần mềm linh động và có khả năng tương thích cao là chìa khóa để khai thác tối đa tiềm năng của hệ thống.

Best Practices

Để khai thác tối đa sức mạnh và đảm bảo hệ thống HPC hoạt động ổn định, hiệu quả, việc tuân thủ các phương pháp hay nhất (best practices) là vô cùng quan trọng. Dưới đây là những khuyến nghị cốt lõi dành cho các nhà quản trị và người dùng hệ thống HPC.

Lựa chọn phần cứng phù hợp với nhu cầu: Đừng chạy theo cấu hình mạnh nhất một cách mù quáng. Hãy phân tích kỹ loại ứng dụng bạn sẽ chạy. Nếu công việc của bạn chủ yếu là các phép tính số học phức tạp, hãy đầu tư vào CPU mạnh. Nếu là mô phỏng đồ họa hoặc học máy, GPU sẽ là ưu tiên hàng đầu. Một hệ thống cân bằng giữa CPU, GPU, bộ nhớ, lưu trữ và mạng sẽ mang lại hiệu quả cao nhất.

Tối ưu hóa song song hóa tác vụ và thuật toán: Đây là yếu tố quyết định hiệu suất. Trước khi chạy một chương trình trên quy mô lớn, hãy đảm bảo mã nguồn đã được song song hóa hiệu quả. Sử dụng các công cụ phân tích hiệu suất (profiler) để tìm ra những đoạn mã gây chậm trễ và tối ưu hóa chúng. Chia nhỏ bài toán một cách thông minh để các nút có thể làm việc độc lập nhất có thể, giảm thiểu giao tiếp không cần thiết.

Định kỳ bảo trì và cập nhật hệ thống HPC: Một hệ thống HPC là một cơ sở hạ tầng phức tạp. Việc bảo trì phần cứng, cập nhật hệ điều hành, driver và các phần mềm quản lý là rất cần thiết để đảm bảo tính ổn định và bảo mật. Lên lịch bảo trì định kỳ để kiểm tra và khắc phục các sự cố tiềm ẩn trước khi chúng gây ra gián đoạn lớn.

Tránh quá tải hệ thống, ưu tiên cân bằng tài nguyên: Sử dụng bộ lập lịch (scheduler) một cách thông minh để quản lý hàng đợi công việc. Thiết lập các chính sách ưu tiên hợp lý để đảm bảo các công việc quan trọng được thực thi trước. Theo dõi liên tục việc sử dụng tài nguyên để tránh tình trạng một vài người dùng chiếm hết tài nguyên của cụm máy, gây ảnh hưởng đến những người khác. Cân bằng tải là chìa khóa cho một môi trường HPC hoạt động công bằng và hiệu quả.

Kết luận

Qua những phân tích chi tiết, có thể thấy rằng Tính toán hiệu năng cao (HPC) không còn là một công nghệ xa vời mà đã trở thành một trụ cột không thể thiếu trong thế giới hiện đại. Từ việc đẩy nhanh các khám phá khoa học mang tính đột phá đến việc tối ưu hóa quy trình sản xuất công nghiệp, HPC đã và đang mở ra những cánh cửa mới cho sự đổi mới. Lợi ích chính của nó nằm ở khả năng tăng tốc xử lý dữ liệu một cách đáng kinh ngạc, cho phép giải quyết các bài toán phức tạp với độ chính xác cao hơn và ở một quy mô chưa từng có.

Vai trò của HPC ngày càng trở nên then chốt trong kỷ nguyên dữ liệu lớn và trí tuệ nhân tạo. Nó là nền tảng sức mạnh tính toán giúp biến những ý tưởng táo bạo nhất thành hiện thực. Vì vậy, việc khuyến khích các doanh nghiệp, viện nghiên cứu và trường đại học đầu tư và áp dụng HPC là một bước đi chiến lược để nâng cao năng lực cạnh tranh và thúc đẩy sự phát triển chung. Việc tiếp cận HPC qua nền tảng đám mây cũng giúp công nghệ này trở nên dân chủ và dễ dàng triển khai hơn bao giờ hết.

Trong tương lai, các công nghệ HPC mới như tính toán lượng tử và vi xử lý thần kinh (neuromorphic) hứa hẹn sẽ tiếp tục định hình lại giới hạn của những gì chúng ta có thể tính toán. Việc nghiên cứu sâu hơn và chuẩn bị sẵn sàng để đón nhận những làn sóng công nghệ này sẽ giúp chúng ta luôn ở vị thế tiên phong trong cuộc cách mạng số.